1入ML深似海啊…

這里主要是《神經(jīng)網(wǎng)絡(luò)與機(jī)器學(xué)習(xí)》(Neural Networks and Learning Machines,以下簡(jiǎn)稱《神機(jī)》)的筆記,和1些周志華的《機(jī)器學(xué)習(xí)》的內(nèi)容,可能夾雜有自己的吐槽,和自己用R語(yǔ)言隨意擼的實(shí)現(xiàn)。

話說這個(gè)《神經(jīng)網(wǎng)絡(luò)與機(jī)器學(xué)習(xí)》還真是奇書,不知是作者風(fēng)格還是翻譯問題,1眼望去看不到幾句人話(或許是水利狗看不懂),感覺我就是純買來自虐的。

作為開始固然是最古老的機(jī)器學(xué)習(xí)算法之1,神經(jīng)網(wǎng)絡(luò)的板磚感知機(jī),對(duì)應(yīng)《神機(jī)》的第1章。

由于是Rosenblatt提出的模型所以就加上了他名字作為前綴。這是1個(gè)有監(jiān)督學(xué)習(xí),也就是不但給出自變量還要給出結(jié)果值讓機(jī)器自個(gè)擬合的模型,而且是1個(gè)2分類模型。再說清楚1點(diǎn),這玩意只能分線性可分的樣本,也就是對(duì)2維的數(shù)據(jù),它只能弄1條直線把樣本分開,對(duì)3維的數(shù)據(jù),只能弄個(gè)平面把樣本分開。

所以像竟然連異或運(yùn)算都不能弄之類的對(duì)它的吐槽歷來很多。

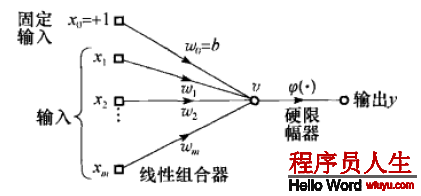

感知機(jī)由1個(gè)線性組合器(說白了就是把1系列輸入值加權(quán)求和)和1個(gè)硬限幅器(說白了就是拿前面的求和取符號(hào))組成。具體模樣參考下圖(來自《神機(jī)》):

我們將1組輸入值記為

又或從幾何角度理解:在m維空間上有這么1個(gè)超平面

所以說樣本必須線性可分的才可以被它分類。

然后這玩意的學(xué)習(xí)方式是不斷的誤差修正,稱為誤差修正學(xué)習(xí)原則。

當(dāng)1個(gè)樣本被正確分類的時(shí)候就沒啥事,要是被毛病分類了就根據(jù)樣本的各個(gè)份量調(diào)劑權(quán)值,就這樣把整套樣本丟進(jìn)去跑幾趟直到誤差收斂為止。

現(xiàn)在干脆把偏置