http://blog.csdn.net/pipisorry/article/details/52578631

本文討論(完備數據的)貝葉斯網的參數估計問題:貝葉斯網的MLE最大似然估計和貝葉斯估計。假定網絡結構是固定的,且假定數據集D包括了網絡變量 的完全觀測實例。

的完全觀測實例。

參數估計的主要方法有兩種:1種基于最大的似然的估計;1種是使用貝葉斯方法。

[參數估計:最大似然估計MLE ]

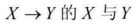

僅包括兩個2元變量的網絡,即弧

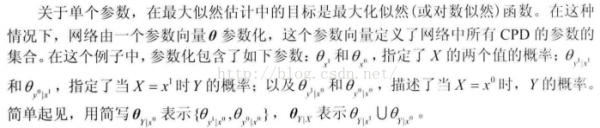

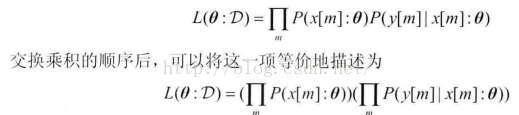

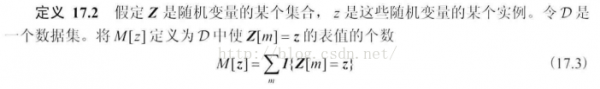

從上看出,似然函數被分解為兩項,且每項對應1個變量。每項都是1個局部的似然函數,度量了在給定其父節點時預測變量的性能。每項都只依賴于變量的CPD的參數。

第1項與前面的多項式似然函數1樣。

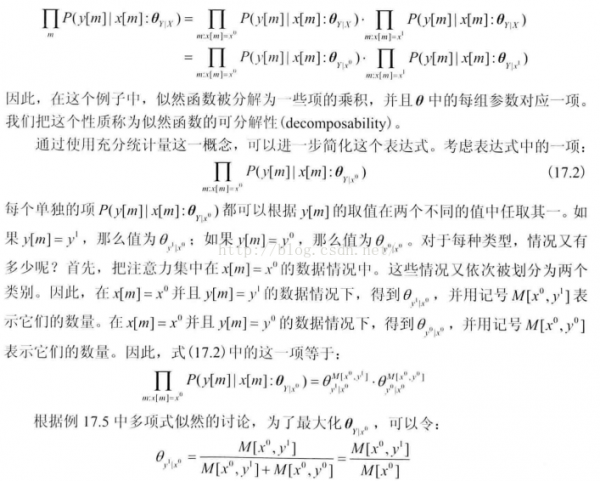

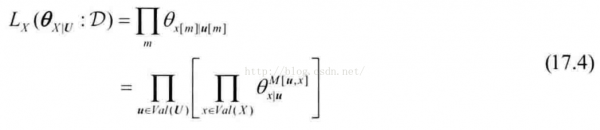

第2項進1步分解:似然函數的可分解性

局部似然函數分解

同理可得theta y0|x0。但是后面有1個更簡單更緊湊的使用CPD表方式快速同時計算這兩個參數的方法。

注意,貝葉斯網中節點代表的是隨機變量(也就是每一個樣本的維度,而不是每一個樣本)。樣本數目為m,維度數為i。

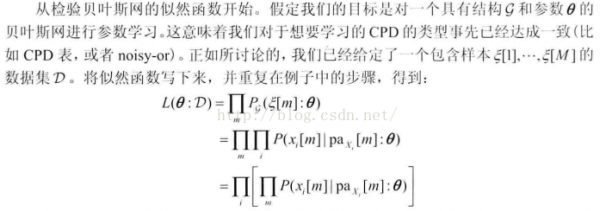

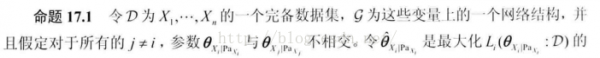

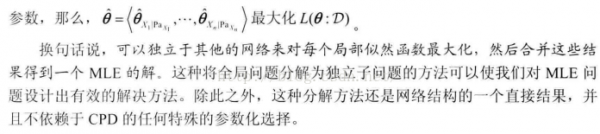

全局似然分解成局部似然函數乘積

Note: 方括號中的每項表示網絡中1個特定變量在給定父節點時的條件似然。

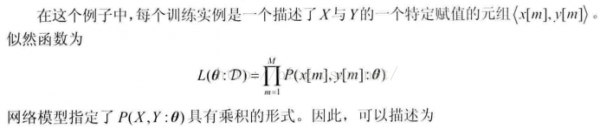

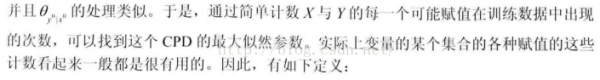

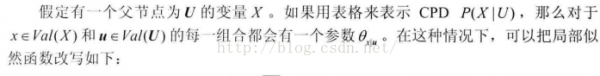

參數的選擇決定了我們最大化每一個局部似然函數的方法。現斟酌1種多是CPD最簡單的參數化:CPD表(table-CPD)。

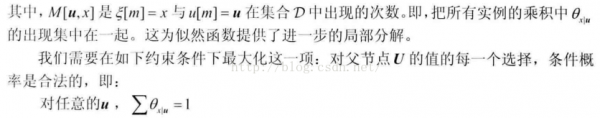

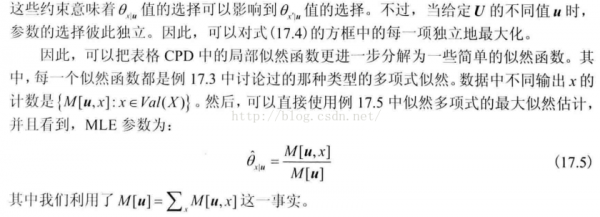

方框項獨立最大化

也就是說,之前簡單的示例中我們是分別計算p(x0|u0)p(x1|u0),現在通過式17.5出現次數(更緊湊的表示)1次同時計算出2個參數p(x0|u0)p(x1|u0)了。

Note: 式17.5就是通過MLE估計出的貝葉斯網的參數計算公式。

。。。

專欄17.B——概念:非參數模型

。。。

皮皮blog

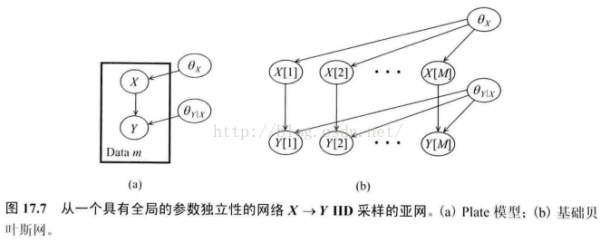

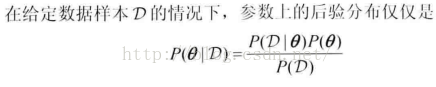

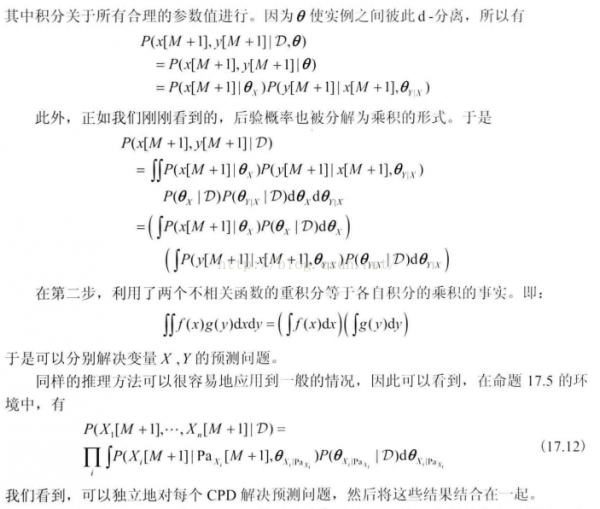

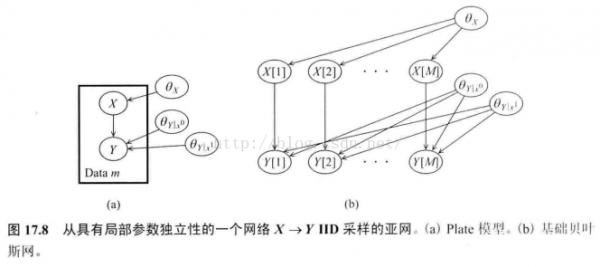

貝葉斯框架要求在未知的參數和數據實例上指定1個聯合散布。與單個參數的情況1樣,可以將參數和數據上的聯合散布理解為1個貝葉斯網。

[參數估計:貝葉斯思想和貝葉斯參數估計 ]

圖7中的b

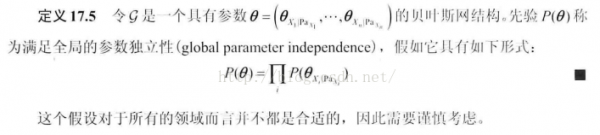

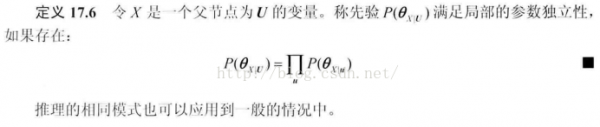

這里有1個假定:網絡結構體現出單個參數變量的先驗是先驗獨立的(沒有觀測到數據時就是獨立的)。即我們認為知道其中1個參數的參數值其實不能告知我們另外一個參數的任何信息。更確切的有以下定義

同時,如果參數變量是先驗獨立的,那末觀測到數據時,也能夠得到它們是后驗獨立的。也就是說,如果這兩個參數是獨立的先驗,那末它們也是獨立的后驗。

也就是后驗可以用緊湊的因子分解的情勢表達。

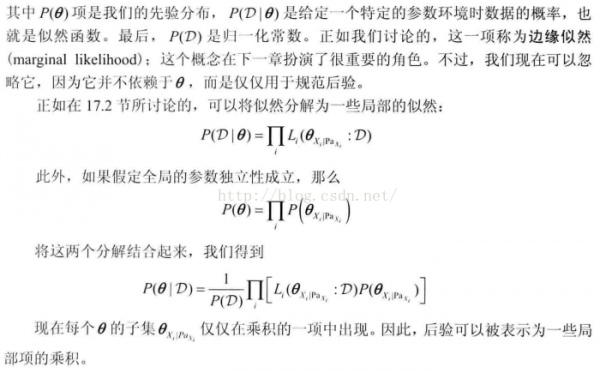

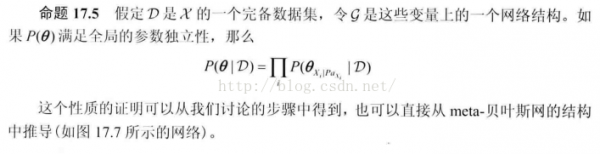

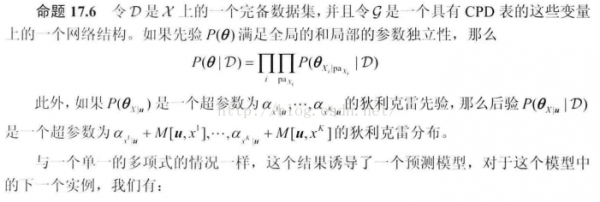

假定已給定了1個具有參數theta的網絡結構G。

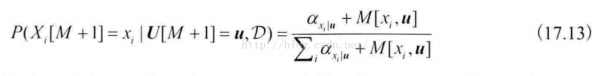

所以,從上面終究的公式中可以看出,這個和MLE很類似,剩下要做的就是先驗p(thetax|pax)的肯定上了(其中p(thetax我們已知道了,如Dirichlet散布))。

通過對局部貝葉斯估計問題求解來得到全局貝葉斯解。

上面獨立先驗的證明:

此式應當也就是貝葉斯網的貝葉斯參數估計計算公式。

專家賦值、K2先驗(相同的固定先驗)、利用先驗數據集(等價于MLE了)、BDe先驗散布。

專欄17.C

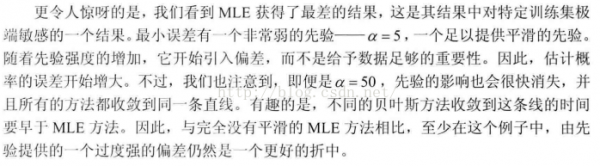

檢驗了MLE方法和1些貝葉斯方法,所有方法使用了統1的先驗均值和不同的先驗強度alpha。

。。。[參數估計:文本分析的參數估計方法]

皮皮blog

from: http://blog.csdn.net/pipisorry/article/details/52578631

ref: [《Probabilistic Graphical Models:Principles and Techniques》(簡稱PGM)]

上一篇 十分鐘玩轉泛型