您當前位置:

首頁 >

互聯網 > kafka-系列1

kafka-系列1

來源:程序員人生 發布時間:2016-06-16 13:32:43 閱讀次數:2740次

問題導讀

1.Kafka獨特設計在甚么地方?

2.Kafka如何搭建及創建topic、發送消息、消費消息?

3.如何書寫Kafka程序?

4.數據傳輸的事務定義有哪3種?

5.Kafka判斷1個節點是不是活著有哪兩個條件?

6.producer是不是直接將數據發送到broker的leader(主節點)?

7.Kafa consumer是不是可以消費指定分區消息?

8.Kafka消息是采取Pull模式,還是Push模式?

9.Procuder API有哪兩種?

10.Kafka存儲在硬盤上的消息格式是甚么?

1、基本概念

介紹

Kafka是1個散布式的、可分區的、可復制的消息系統。它提供了普通消息系統的功能,但具有自己獨特的設計。

這個獨特的設計是甚么樣的呢?

首先讓我們看幾個基本的消息系統術語:

Kafka將消息以topic為單位進行歸納。

將向Kafka topic發布消息的程序成為producers.

將預訂topics并消費消息的程序成為consumer.

Kafka以集群的方式運行,可以由1個或多個服務組成,每一個服務叫做1個broker.

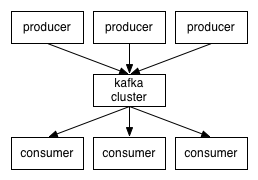

producers通過網絡將消息發送到Kafka集群,集群向消費者提供消息,以下圖所示:

客戶端和服務端通過TCP協議通訊。Kafka提供了Java客戶端,并且對多種語言都提供了支持。

Topics 和Logs

先來看1下Kafka提供的1個抽象概念:topic.

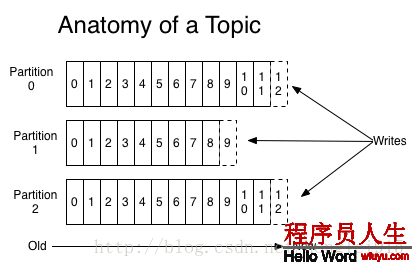

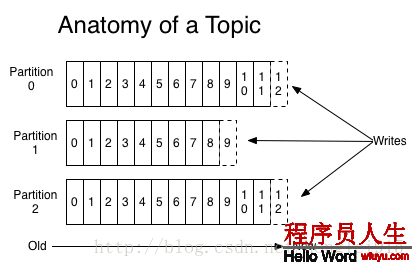

1個topic是對1組消息的歸納。對每一個topic,Kafka 對它的日志進行了分區,以下圖所示:

客戶端和服務端通過TCP協議通訊。Kafka提供了Java客戶端,并且對多種語言都提供了支持。

Topics 和Logs

先來看1下Kafka提供的1個抽象概念:topic.

1個topic是對1組消息的歸納。對每一個topic,Kafka 對它的日志進行了分區,以下圖所示:

每一個分區都由1系列有序的、不可變的消息組成,這些消息被連續的追加到分區中。分區中的每一個消息都有1個連續的序列號叫做offset,用來在分區中唯1的標識這個消息。

在1個可配置的時間段內,Kafka集群保存所有發布的消息,不管這些消息有無被消費。比如,如果消息的保存策略被設置為2天,那末在1個消息被發布的兩天時間內,它都是可以被消費的。以后它將被拋棄以釋放空間。Kafka的性能是和數據量無關的常量級的,所以保存太多的數據其實不是問題。

實際上每一個consumer唯1需要保護的數據是消息在日志中的位置,也就是offset.這個offset有consumer來保護:1般情況下隨著consumer不斷的讀取消息,這offset的值不斷增加,但其實consumer可以以任意的順序讀取消息,比如它可以將offset設置成為1個舊的值來重讀之前的消息。

以上特點的結合,使Kafka consumers非常的輕量級:它們可以在不對集群和其他consumer造成影響的情況下讀取消息。你可使用命令行來"tail"消息而不會對其他正在消費消息的consumer造成影響。

將日志分區可以到達以下目的:首先這使得每一個日志的數量不會太大,可以在單個服務上保存。另外每一個分區可以單獨發布和消費,為并發操作topic提供了1種可能。

散布式

每一個分區在Kafka集群的若干服務中都有副本,這樣這些持有副本的服務可以共同處理數據和要求,副本數量是可以配置的。副本使Kafka具有了容錯能力。

每一個分區都由1個服務器作為“leader”,零或若干服務器作為“followers”,leader負責處理消息的讀和寫,followers則去復制leader.如果leader down了,followers中的1臺則會自動成為leader。集群中的每一個服務都會同時扮演兩個角色:作為它所持有的1部份分區的leader,同時作為其他分區的followers,這樣集群就會據有較好的負載均衡。

Producers

Producer將消息發布到它指定的topic中,并負責決定發布到哪一個分區。通常簡單的由負載均衡機制隨機選擇分區,但也能夠通過特定的分區函數選擇分區。使用的更多的是第2種。

Consumers

發布消息通常有兩種模式:隊列模式(queuing)和發布-定閱模式(publish-subscribe)。隊列模式中,consumers可以同時從服務端讀取消息,每一個消息只被其中1個consumer讀到;發布-定閱模式中消息被廣播到所有的consumer中。Consumers可以加入1個consumer

組,共同競爭1個topic,topic中的消息將被分發到組中的1個成員中。同1組中的consumer可以在不同的程序中,也能夠在不同的機器上。如果所有的consumer都在1個組中,這就成了傳統的隊列模式,在各consumer中實現負載均衡。如果所有的consumer都不在不同的組中,這就成了發布-定閱模式,所有的消息都被分發到所有的consumer中。更常見的是,每一個topic都有若干數量的consumer組,每一個組都是1個邏輯上的“定閱者”,為了容錯和更好的穩定性,每一個組由若干consumer組成。這其實就是1個發布-定閱模式,只不過定閱者是個組而不是單個consumer。

每一個分區都由1系列有序的、不可變的消息組成,這些消息被連續的追加到分區中。分區中的每一個消息都有1個連續的序列號叫做offset,用來在分區中唯1的標識這個消息。

在1個可配置的時間段內,Kafka集群保存所有發布的消息,不管這些消息有無被消費。比如,如果消息的保存策略被設置為2天,那末在1個消息被發布的兩天時間內,它都是可以被消費的。以后它將被拋棄以釋放空間。Kafka的性能是和數據量無關的常量級的,所以保存太多的數據其實不是問題。

實際上每一個consumer唯1需要保護的數據是消息在日志中的位置,也就是offset.這個offset有consumer來保護:1般情況下隨著consumer不斷的讀取消息,這offset的值不斷增加,但其實consumer可以以任意的順序讀取消息,比如它可以將offset設置成為1個舊的值來重讀之前的消息。

以上特點的結合,使Kafka consumers非常的輕量級:它們可以在不對集群和其他consumer造成影響的情況下讀取消息。你可使用命令行來"tail"消息而不會對其他正在消費消息的consumer造成影響。

將日志分區可以到達以下目的:首先這使得每一個日志的數量不會太大,可以在單個服務上保存。另外每一個分區可以單獨發布和消費,為并發操作topic提供了1種可能。

散布式

每一個分區在Kafka集群的若干服務中都有副本,這樣這些持有副本的服務可以共同處理數據和要求,副本數量是可以配置的。副本使Kafka具有了容錯能力。

每一個分區都由1個服務器作為“leader”,零或若干服務器作為“followers”,leader負責處理消息的讀和寫,followers則去復制leader.如果leader down了,followers中的1臺則會自動成為leader。集群中的每一個服務都會同時扮演兩個角色:作為它所持有的1部份分區的leader,同時作為其他分區的followers,這樣集群就會據有較好的負載均衡。

Producers

Producer將消息發布到它指定的topic中,并負責決定發布到哪一個分區。通常簡單的由負載均衡機制隨機選擇分區,但也能夠通過特定的分區函數選擇分區。使用的更多的是第2種。

Consumers

發布消息通常有兩種模式:隊列模式(queuing)和發布-定閱模式(publish-subscribe)。隊列模式中,consumers可以同時從服務端讀取消息,每一個消息只被其中1個consumer讀到;發布-定閱模式中消息被廣播到所有的consumer中。Consumers可以加入1個consumer

組,共同競爭1個topic,topic中的消息將被分發到組中的1個成員中。同1組中的consumer可以在不同的程序中,也能夠在不同的機器上。如果所有的consumer都在1個組中,這就成了傳統的隊列模式,在各consumer中實現負載均衡。如果所有的consumer都不在不同的組中,這就成了發布-定閱模式,所有的消息都被分發到所有的consumer中。更常見的是,每一個topic都有若干數量的consumer組,每一個組都是1個邏輯上的“定閱者”,為了容錯和更好的穩定性,每一個組由若干consumer組成。這其實就是1個發布-定閱模式,只不過定閱者是個組而不是單個consumer。

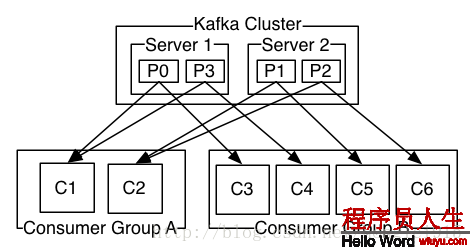

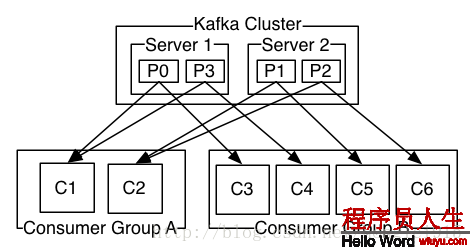

由兩個機器組成的集群具有4個分區 (P0-P3) 2個consumer組. A組有兩個consumerB組有4個

相比傳統的消息系統,Kafka可以很好的保證有序性。

由兩個機器組成的集群具有4個分區 (P0-P3) 2個consumer組. A組有兩個consumerB組有4個

相比傳統的消息系統,Kafka可以很好的保證有序性。

傳統的隊列在服務器上保存有序的消息,如果多個consumers同時從這個服務器消費消息,服務器就會以消息存儲的順序向consumer分發消息。雖然服務器按順序發布消息,但是消息是被異步的分發到各consumer上,所以當消息到達時可能已失去了原來的順序,這意味著并發消費將致使順序錯亂。為了不故障,這樣的消息系統通常使用“專用consumer”的概念,其實就是只允許1個消費者消費消息,固然這就意味著失去了并發性。

在這方面Kafka做的更好,通過分區的概念,Kafka可以在多個consumer組并發的情況下提供較好的有序性和負載均衡。將每一個分辨別只分發給1個consumer組,這樣1個分區就只被這個組的1個consumer消費,就能夠順序的消費這個分區的消息。由于有多個分區,仍然可以在多個consumer組之間進行負載均衡。注意consumer組的數量不能多于分區的數量,也就是有多少分區就允許多少并發消費。

Kafka只能保證1個分區以內消息的有序性,在不同的分區之間是不可以的,這已可以滿足大部份利用的需求。如果需要topic中所有消息的有序性,那就只能讓這個topic只有1個分區,固然也就只有1個consumer組消費它。

###########################################

2、環境搭建

Step 1: 下載Kafka

點擊下載最新的版本并解壓.

-

> tar -xzf kafka_2.9.2-0.8.1.1.tgz

-

> cd kafka_2.9.2-0.8.1.1

復制代碼

Step 2: 啟動服務

Kafka用到了Zookeeper,所有首先啟動Zookper,下面簡單的啟用1個單實例的Zookkeeper服務。可以在命令的結尾加個&符號,這樣就能夠啟動后離開控制臺。

-

> bin/zookeeper-server-start.sh config/zookeeper.properties &

-

[2013-04⑵2 15:01:37,495] INFO Reading configuration from: config/zookeeper.properties (org.apache.zookeeper.server.quorum.QuorumPeerConfig)

-

...

復制代碼

現在啟動Kafka:

-

> bin/kafka-server-start.sh config/server.properties

-

[2013-04⑵2 15:01:47,028] INFO Verifying properties (kafka.utils.VerifiableProperties)

-

[2013-04⑵2 15:01:47,051] INFO Property socket.send.buffer.bytes is overridden to 1048576 (kafka.utils.VerifiableProperties)

-

...

復制代碼

Step 3: 創建 topic

創建1個叫做“test”的topic,它只有1個分區,1個副本。

-

> bin/kafka-topics.sh --create --zookeeper localhost:2181 --replication-factor 1 --partitions 1 --topic test

復制代碼

可以通過list命令查看創建的topic:

-

> bin/kafka-topics.sh --list --zookeeper localhost:2181

-

test

復制代碼

除手動創建topic,還可以配置broker讓它自動創建topic.

Step 4:發送消息.

Kafka 使用1個簡單的命令行producer,從文件中或從標準輸入中讀取消息并發送到服務端。默許的每條命令將發送1條消息。

運行producer并在控制臺中輸1些消息,這些消息將被發送到服務端:

-

> bin/kafka-console-producer.sh --broker-list localhost:9092 --topic test

-

This is a messageThis is another message

復制代碼

ctrl+c可以退動身送。

Step 5: 啟動consumer

Kafka also has a command line consumer that will dump out messages to standard output.

Kafka也有1個命令行consumer可以讀取消息并輸出到標準輸出:

-

> bin/kafka-console-consumer.sh --zookeeper localhost:2181 --topic test --from-beginning

-

This is a message

-

This is another message

復制代碼

你在1個終端中運行consumer命令行,另外一個終端中運行producer命令行,就能夠在1個終端輸入消息,另外一個終端讀取消息。

這兩個命令都有自己的可選參數,可以在運行的時候不加任何參數可以看到幫助信息。

Step 6: 搭建1個多個broker的集群

剛才只是啟動了單個broker,現在啟動有3個broker組成的集群,這些broker節點也都是在本機上的:

首先為每一個節點編寫配置文件:

-

> cp config/server.properties config/server⑴.properties

-

> cp config/server.properties config/server⑵.properties

復制代碼

在拷貝出的新文件中添加以下參數:

-

config/server⑴.properties:

-

broker.id=1

-

port=9093

-

log.dir=/tmp/kafka-logs⑴

復制代碼

-

config/server⑵.properties:

-

broker.id=2

-

port=9094

-

log.dir=/tmp/kafka-logs⑵

復制代碼

broker.id在集群中唯1的標注1個節點,由于在同1個機器上,所以必須制定不同的端口和日志文件,避免數據被覆蓋。

We already have Zookeeper and our single node started, so we just need to start the two new nodes:

剛才已啟動可Zookeeper和1個節點,現在啟動另外兩個節點:

-

> bin/kafka-server-start.sh config/server⑴.properties &

-

...

-

> bin/kafka-server-start.sh config/server⑵.properties &

-

...

復制代碼

創建1個具有3個副本的topic:

-

> bin/kafka-topics.sh --create --zookeeper localhost:2181 --replication-factor 3 --partitions 1 --topic my-replicated-topic

復制代碼

現在我們搭建了1個集群,怎樣知道每一個節點的信息呢?運行“"describe topics”命令就能夠了:

-

> bin/kafka-topics.sh --describe --zookeeper localhost:2181 --topic my-replicated-topic

復制代碼

-

Topic:my-replicated-topic PartitionCount:1 ReplicationFactor:3 Configs:

-

Topic: my-replicated-topic Partition: 0 Leader: 1 Replicas: 1,2,0 Isr: 1,2,0

復制代碼

下面解釋1下這些輸出。第1行是對所有分區的1個描寫,然后每一個分區都會對應1行,由于我們只有1個分區所以下面就只加了1行。

leader:負責處理消息的讀和寫,leader是從所有節點中隨機選擇的.

replicas:列出了所有的副本節點,不管節點是不是在服務中.

isr:是正在服務中的節點.

在我們的例子中,節點1是作為leader運行。

向topic發送消息:

-

> bin/kafka-console-producer.sh --broker-list localhost:9092 --topic my-replicated-topic

復制代碼

-

...

-

my test message 1my test message 2^C

復制代碼

消費這些消息:

-

> bin/kafka-console-consumer.sh --zookeeper localhost:2181 --from-beginning --topic my-replicated-topic

復制代碼

-

...

-

my test message 1

-

my test message 2

-

^C

復制代碼

測試1下容錯能力.Broker 1作

生活不易,碼農辛苦

如果您覺得本網站對您的學習有所幫助,可以手機掃描二維碼進行捐贈

------分隔線----------------------------

------分隔線----------------------------